zzsilence 发表于 2016-10-17 15:59 具体需要看源码了,但是就从楼主的描述来看,我们要尽量减少可能出错的地方。spark应该配成1.6.0,然后最好重启下,在试试 "kernelspec": { "name": "spark", "display_name": "Scala [2.11.7] Spark [1.6.2] Hadoop [2.6.0] " } |

starrycheng 发表于 2016-10-17 15:35 谢谢你的耐心回复:) 我是直接从 spark-notebook.io 下载的 spark-notebook-0.6.3-scala-2.11.7-spark-1.6.0-hadoop-2.6.0.tar版本,应该是没有兼容性问题的我想问下这个spark notebook 运行的原理是什么呢?它是怎么进行kernel starting的呢?这里的kernel是指什么? "kernelspec": { "name": "spark", "display_name": "Scala [2.11.7] Spark [1.6.2] Hadoop [2.6.0] " } 这个配置只有"name"和"display_name",它是从哪里加载spark, hadoop的配置文件的呢? 抱歉,这个我真是不懂,问题比较多... |

本帖最后由 starrycheng 于 2016-10-17 15:38 编辑 zzsilence 发表于 2016-10-17 15:16 元数据只需要配置就好了。 kernel的配置,可能存在版本兼容性问题 楼主的: Scala,spark,hadoop这三者是否测试兼容 |

starrycheng 发表于 2016-10-17 15:11 metadata我就修改了customSparkConf,其他的不知道怎么改..就像下面的 { "name": "Spark 101", "user_save_timestamp": "1970-01-01T01:00:00.000Z", "auto_save_timestamp": "2015-01-10T00:02:12.659Z", "language_info": { "name": "scala", "file_extension": "scala", "codemirror_mode": "text/x-scala" }, "trusted": true, "customLocalRepo": null, "customRepos": null, "customDeps": null, "customImports": null, "customArgs": null, "customSparkConf": { "spark.app.name": "Notebook", "spark.master": "spark://slave2:7077", "spark.executor.memory": "1G" }, "kernelspec": { "name": "spark", "display_name": "Scala [2.11.7] Spark [1.6.2] Hadoop [2.6.0] " } } 你用Spark Notebook了吗? 我在网上没找到什么教程,真是不知道怎么弄... 你能写一下步骤吗 |

|

元数据驱动是怎么配置的 |

arsenduan 发表于 2016-10-17 14:38 我用的standalone |

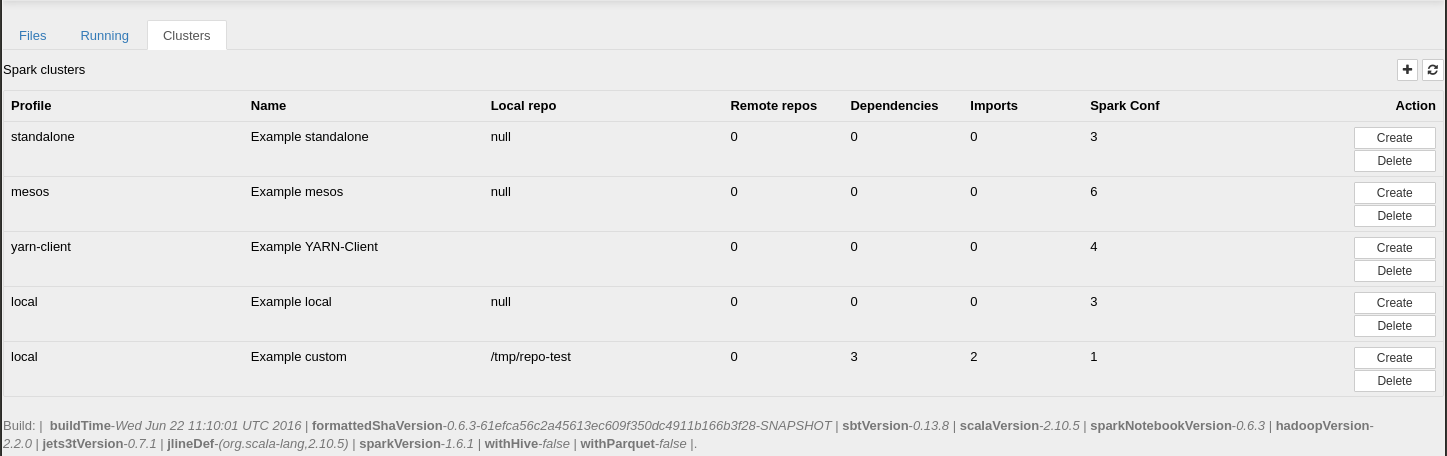

arsenduan 发表于 2016-10-17 14:38 谢谢你的回复。 cluster-tab下面有挺多配置,我不知道怎么配置...,就只修改了SparkConf, 还是不行... 你用notebook了吗?咋弄的? |

看下cluster-tab

是采用什么方式运行的 |

/2

/2